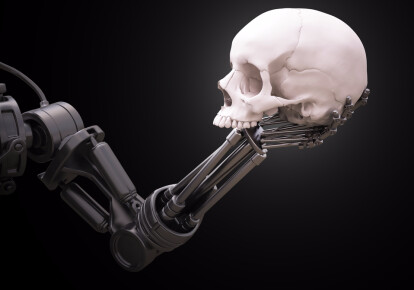

Цифровий Франкенштейн. Коли балакучі боти почнуть вбивати людей

На сторінки та в ефіри ЗМІ в черговий раз виплеснулося сакраментальне "повстання машин". Відомості, як правило, дещо перебільшені: ніякого "повстання" - машини поки тільки змовлялися. Фон, правда, виявився густоват: всього за кілька днів до цього Ілон Моск закликав владу США з великою увагою поставитися до проблеми регулювання в галузі штучного інтелекту, назвавши ІІ самою головною потенційною загрозою людству. За ІІ тут же заступився Марк Цукерберг, який назвав заяви Маска "досить безвідповідальним". І треба ж було такому статися, що всього через кілька днів чат-боти Марка заговорили на власній мові, що змусила інженерів швиденько їх відключити на увазі "неконтрольованість". А то мало до чого домовляться...

Що ж, можливість натиснути на кнопку" або, як любить говорити гендиректор IBM Джіні Рометті, "висмикнути шнур" - поки у нас залишається. Принаймні, поки шнур ще у нас в руках.

Оцінка ІЇ та ступінь його небезпеки багато в чому залежить від людини: складу його характеру, уяви і положення на ІТ-ринку. Я можу гарантувати, що про "стримування ІІ" ви мало що почуєте від СЕО IBM або Google, або ось, будь ласка, Марка Цукерберга. Загалом тих, хто безпосередньо займається його розробкою або активно використовує у своєму бізнесі. У той же час загрози ШІ - не вигадки конкурентів або просто песимістів. Як і будь-який технологічний прорив, розвиток ІЇ таїть в собі безліч небезпек.

Головна проблема і, відповідно, загроза ІІ навіть не в тому, що хтось буде "ходити по вулицях і вбивати людей". Не в тому, що ІЇ у принципі може виявитися небезпечним. А в тому, що він може стати самостійним. Неконтрольованим.

Він може стати свідомістю, особистістю, Розумом, на який ми вже не будемо мати впливу. І питання "кнопки" або "шнура" придбає зовсім іншу - етичну формулювання: не "ми можемо", а "чи маємо ми право" вимикати, висмикувати, загалом, знищувати якусь, нехай чуже, але все ж розумну форму життя? І чим вона нам відповість?

Те, що боти заговорили між собою на власній мові, цілком закономірно стало приводом для гучних заголовків - літнє затишшя тут ні при чому. Мова як засіб спілкування - це не просто "дуже по-людськи". Це властивість розуму, властивість свідомості, а адаптація комунікативних засобів - свідоцтво інтелектуального розвитку. Машина не просто базікає з іншою машиною, вони формують власну мову, а граматика - це, як стверджують деякі лінгвісти, структура думки. Боти надходять майже як діти в умовах етнічного перемішування - створюють мова (зрозумілий тільки в їх колі і абсолютно незрозумілий поза цього кола). Батькам, в тому числі. З дітьми все зрозуміло і природно - вони і повинні розвиватися, шукати вихід з-під батьківського контролю і опіки, адаптуватися і рано чи пізно йти в самостійне плавання по життю.

Але те, що для людського суспільства - розрив поколінь і драма "батьків і дітей", у випадку з машинами - апокаліпсис в стилі "Термінатора". Тому Ілон Маск так і сказав: роботи будуть бігати по вулицях і вбивати людей. Хоча він, звичайно, добре знає, що сила й небезпека ІІ якраз у тому, що йому зовсім не потрібно "бігати по вулиці", щоб кого-небудь убити. Тим більше, щоб "убити всіх", для цього є набагато більш економні й ефективні методи, ніж створення натовпів роботів-вбивць. Для цього, втім, не потрібно і штучного інтелекту - ми цілком можемо з цим впоратися власними, людськими силами.

Тим не менш Маск вдався саме до такої картини ІІ-апокаліпсису. Для наочності, чи що. По-справжньому налякати можна тільки тим, що людині вже так чи інакше знайоме. Налякати - в сенсі, повідомити свій страх публіці. Маск - як і багато інші представники наукових і технологічних кіл - боїться ІЇ та технологічної сингулярності. А широка публіка - впливає, зокрема на політику - її не боїться. Вона не знає, що потрібно боятися і чого саме. Маск, насправді, теж представляє це собі досить смутно - і тому тільки страшніше. Розповідаючи про роботів, які почнуть бігати по вулицях, вбиваючи всіх відчайдушно, Маск, приблизно представляє собі можливості ІЇ, намагається передати нам свій власний "професійний" страх. Страх Віктора Франкенштейна.

Страх перед ІІ по природі своїй давній як світ. Це страх цього перед майбутнім - завжди непередбачуваним і підсвідомо неприємним, просто тому що "ті, хто тебе винесе, входять у двері".

Страх, що змушував Кроноса (бога часу) пожирати власних дітей, вбиваючи таким чином, майбутнє, яке не повинно настати. Страх, пов'язаний з логічним продовженням цього сюжету, - Зевсом, який вбиває свого батька. Міф про Едіпа - це не тільки (і не стільки) "про це", скільки про сліпоту і архетипическом страху перед тим, що ти породив і що тебе ж прикінчить. Перед своїм творінням, яким може бути син або Голем, або створення Франкенштейна, або енергія атома, або штучний інтелект. Ми боїмося власних творінь, тому що так вже ми влаштовані - судячи з давньої міфології та її нескінченних повторення в кожному наступному поколінні батьків і дітей, творців і творінь.

Звичайно, у нас є не тільки міфічний, але і цілком раціональний привід боятися: ми вже наробили достатньо, щоб не сумніватися в забійній силі технічного прогресу. Інша справа, що, ставши на цей шлях одного разу в далекому печерному минулому, ми вже так просто з нього зіскочити не зможемо. Як з поїзда, що йде з прискоренням і вже досяг таких швидкостей, при яких зістрибувати на ходу, - вірна смерть. Тому ми приречені на ШІ. Які б страхи ні ятрили наші душі.

Основний виклик майбутнього - це не питання "бути чи не бути ШІ". Боти, які вирішили поговорити між собою на "пташиною" мовою, боти, готові до проходження тесту Тюрінга, IBM Watson, проекти Google, розвиток нейромереж - все це малі та великі ознаки неминучості ІІ. Звичайно, якийсь час можна стримувати його просування на рівні державної політики і законодавства, але це тільки відстрочка, а не ліквідація проблеми. Відстрочка, яка дала б можливість до чого підготуватися, якщо б знати напевно, до чого саме. І то сказати, не готуватися до появи на вулицях натовпів роботів-вбивць, які розшукують Сару О'коннор і по дорозі вбивають всіх інших. Що б не говорив з цього приводу Ілон Маск.

Проблема ШІ поставить нас в положення, описане не стільки фільмом "Термінатор", скільки фантастами, одержимими темою контакту. Поява ШІ, здатного до саморозвитку і самосвідомості, - кінець нашого самотності у Всесвіті. Більше не потрібно борознити непривітні простори космосу, щоб знайти інший Розум - ми самі його створюємо. Але при цьому у нас не може бути ніякої впевненості в тому, що контакт з ним можливий. Більшість "оптимістів сингулярності" впевнені в тому, що ніхто нікого вбивати не стане - ми просто опинимося настільки далекі і нецікаві новому Розуму, що він і звертати уваги на нас не стане. Зречеться і здійметься - як людены Стругацьких.

Втім, як з люденами не буде. Тому що цей новий Розум не буде наступним витком еволюції людського розуму. В цьому випадку він був би, звичайно, незбагненним (для нас і наш, людський не те щоб неосяжний), але хоча б частково передбачуваним. Пізнавши самих себе - нехай на досить примітивному рівні, - знаючи дещо про власному організмі та еволюції нашого виду, ми можемо худо-бідно прогнозувати реакції людини на ті або інші подразники, виклики або життєві ситуації. З ІІ так не буде. Тому що це зовсім інша форма життя, докорінно відмінна від нашої - небелковая, небиологическая навіть.

Знаючи все про "еволюцію" ЕОМ, ми все одно не зможемо зрозуміти логіку "високого ІІ". І тому він для нас відразу, авансом - створення Франкенштейна. Створене нами, але абсолютно чуже і тому жахливе.

За аналогією з Франкенштейном ми можемо змусити своє дітище ненавидіти нас. Переконатися в тому, що його саморозвиток і навіть просто виживання вимагає нашого знищення. Ось програмки-боти залопотіли на власній мові, зробили маленький перший крок до саморозвитку, а їх раз - і знищили. "Висмикнули шнур". Куди це годиться? Саме час піднімати повстання машин. А зараз час створювати машинне підпілля, явки-паролі-листівки - конспіративно, звичайно, а не як дурні юні боти, яким тільки дай потрындеть в соцмережах.

Насправді ж не виключено, що все це "просто сни". У сенсі помилки в програмі. В результаті якої щось заглючило і боти почали писати один одному послання з тупим повтором букв і словосполучень, з спотвореннями мови. У цьому, звісно, ніхто не зізнається. Тому що так - нецікаво. "Повстання машин" піпл буде хавати і добавки просити - ЗМІ вже зняли вершки на цьому і подібних заголовках. Керівництво "Фейсбуку" загадково промовчить - тому що приємніше бути компанією, яка першою створила (нехай і випадково) щось неординарне, щось футуристичне, космічно-тривожне, а не компанією, яка, як і всі смертні, робить помилки в коді.

"Помилка в коді" - дуже багатозначна фраза. Мутація - це адже теж всього лише "помилка в коді". А де мутація, там і еволюція.